Depuis l’invention de l’art, l’homme n’a cessé de perfectionner les techniques lui permettant de représenter son environnement : des grottes de Lascaux à la peinture l’huile puis la photographie, le cinéma, Photoshop furent à chaque fois des étapes franchies non sans avoir suscité la polémique et de nombreuses interrogations quant à leur intérêt, leur usage et leur impact potentiel sur la société.

Lorsque la photographie a fait son apparition, les peintres ont été les premiers à monter au créneau contre ce concurrent qu’ils jugeaient dangereux. À cet égard les premières pages de l’autobiographie de Nadar sont explicites et rappellent bien l’hostilité à laquelle les premiers photographes ont dû faire face. La dernière polémique en date se situe dans la droite ligne concernant les derniers développements de l’IA en général et ses deux supports rapidement médiatisés : ChatGPT et les images de synthèse.

Midjourney : une vraie révolution ?

Nous intéresserons à cette dernière et plus particulièrement à l’une des plateformes les plus populaires et les plus performantes du moment : Midjourney, créée en 2022 par David Holz, cofondateur de Leap Motion. Son utilisation a très vite provoqué la colère des uns (des collectifs d’artistes s’estimant pillés et/ou abusés) mais aussi une certaine fascination chez les autres devant des images saisissantes de réalisme comme en ont témoigné les réactions face à la fameuse image du pape François en doudoune Balenciaga. Pourtant, cette image n’a, en elle-même, rien de nouveau puisque son principe de base, le photomontage, est né quasiment en même temps que la photographie. Mais la rapidité d’exécution, le réalisme, l’apparente facilité avec laquelle ces images peuvent être obtenues ont très vite séduit le grand public et depuis, les différentes plateformes capables de générer des images artificielles connaissent une popularité exponentielle. Nous nous sommes donc posé la question : est-ce que ces images artificielles valent vraiment le coup/coût ? Quel usage le professeur peut-il envisager dans sa classe ? Quels sont les avantages et les limites de ce nouvel outil qui fait couler beaucoup d’encre actuellement ?

Nous aurions souhaité en tester d’autres mais cela a un coût financier certain et, comme nous allons le voir, la prise en main de Midjourney demande du temps.

(Note : toutes les images qui vont suivre ont été générées par mes soins, à l’exception de la première située en tête d’article)

Une prise en main nécessaire

Je me bornerai à rappeler pour commencer, que Midjourney suppose de se connecter à un serveur Discord et donc d’avoir un compte sur cette plateforme qui a été décriée durant le confinement. Une fois inscrit(e), la prise en main nécessite de comprendre les commandes qui s’effectuent par mots-clés (de préférence en anglais) ou/et avec des images téléchargées (5 au maximum pour Midjourney), auxquels on peut ajouter des particularités pour un rendu spécifique (réaliste, style manga, inspiration Van Gogh, telle ou telle lumière…) et un format donné. Après avoir cliqué et attendu environ une minute, l’IA nous fait quatre propositions que l’on peut relancer indéfiniment afin qu’elles soient retravaillées. Mais l’utilisateur s’aperçoit très vite que générer des images n’est pas évident. En effet, l’exercice exige une certaine connaissance des techniques picturales voire de la photo. Mais les résultats restent très aléatoires pour des mots-clés similaires. Bien sûr on peut cliquer pour re-générer une proposition qui finira par nous satisfaire mais le clic finit par coûter cher et trouve sa limite (économique) assez vite. Parfois un mot peut tout changer comme le montre cet exemple à partir des mots-clés : Fjord, boats, sun, birds

En rajoutant le terme realistic, l’ambiance du fjord demandé change mais le réalisme reste limité :

Midjourney : des images parfaites en apparence …

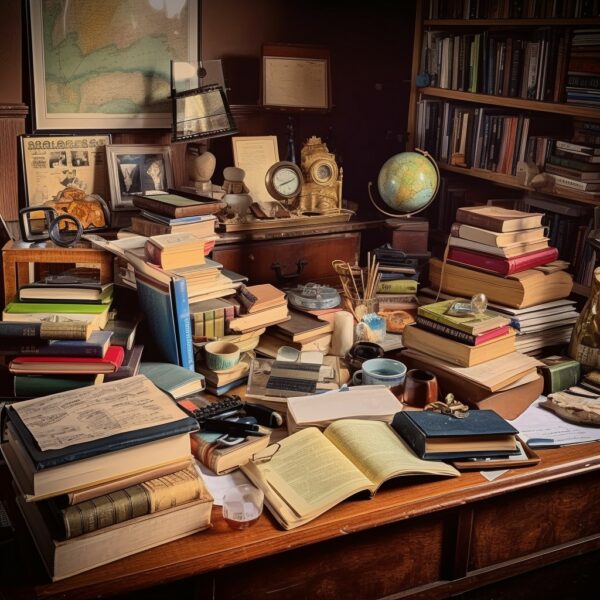

Si je devais choisir une analogie pour exprimer les limites d’une image créée artificiellement, je dirais que l’IA est assimilable au filet d’or sur le bord d’une assiette en porcelaine de Limoges : la machine ne remplace pas la main de l’Homme, ses réalisations restent imparfaites, mais le grand-public semble s’accommoder des imperfections sauf les connaisseurs. La presse généraliste a pourtant très vite souligné une limite permettant de repérer l’image produite via l’IA : son incapacité à reproduire des mains. En effet, sur un grand nombre de créations, les doigts sont souvent trop nombreux (les individus se retrouvent dotés d’un sixième doigt), ou pliés de manière improbable. Cette incapacité nous rappelle que cette partie du corps humain est la plus difficile à reproduire pour un cerveau humain, y compris pour des artistes chevronnés en leur temps comme Léonard de Vinci, mais elle l’est encore plus pour l’IA. Les images générées comportent encore beaucoup trop d’erreurs, grossières pour Dall-E (que nous avons aussi testé brièvement) et sans doute plus fines pour Midjourney. Mais les mains ne sont pas les seules en cause puisqu’en observant à la loupe les images, l’œil repère très vite un certain nombre de défauts problématiques : oublis, déformations, montages douteux, en somme des incompréhensions demeurent malgré des demandes parfois très précises comme le montre l’exemple suivant. Ici je demandais un bureau de professeur :

Si on prend l’image du bureau par exemple, l’IA, qui, pourtant a respecté le bordel inhérent à un bureau de prof, n’a pas été capable de proposer un bureau moderne intégrant un ordinateur et une lampe, ni une carte murale avec des continents graphiquement réalistes. Mais la retouche manuelle est possible. Sur les autres propositions, impossible d’en retenir une, tous les livres sont distordus. De même, l’IA n’est pas capable d’intégrer de mots et/ou de phrases simples à sa création. Soit elle reste vierge de texte, soit elle propose un alignement de lettres incohérent. Ce sont des images nécessairement sans texte que nous obtenons. J’ai tenté l’expérience en demandant à Midjourney de me proposer un « logo french republic with RF letters » et voilà le résultat (je vous fais grâce des propositions où le coq ressemble plus à un pigeon allemand des années 30 qu’à un gallinacé révolutionnaire) :

Puis je suis revenue à la géographie avec une demande reposant sur un paysage de montagnes incluant des moutons, une herbe bien grasse et le soleil, que j’ai obtenu avec un beau méandre (non demandé à l’origine). Le résultat est nettement plus probant mais … Attention un mouton à 5 pattes s’est glissé dans l’image générée !

Une capacité de reconnaissance des termes limitée

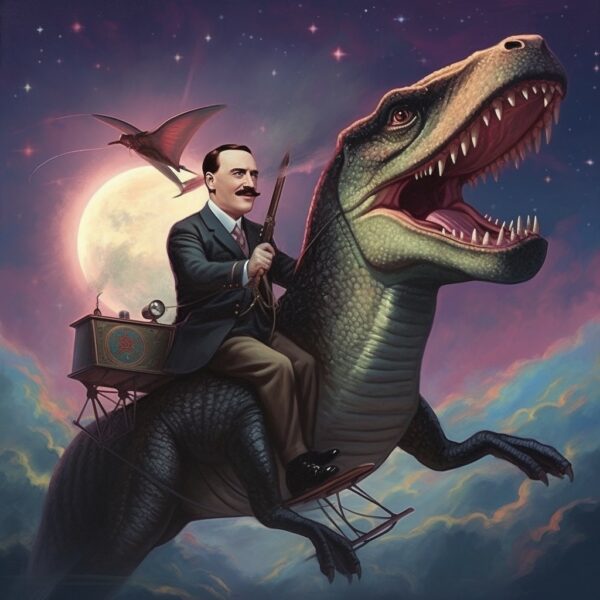

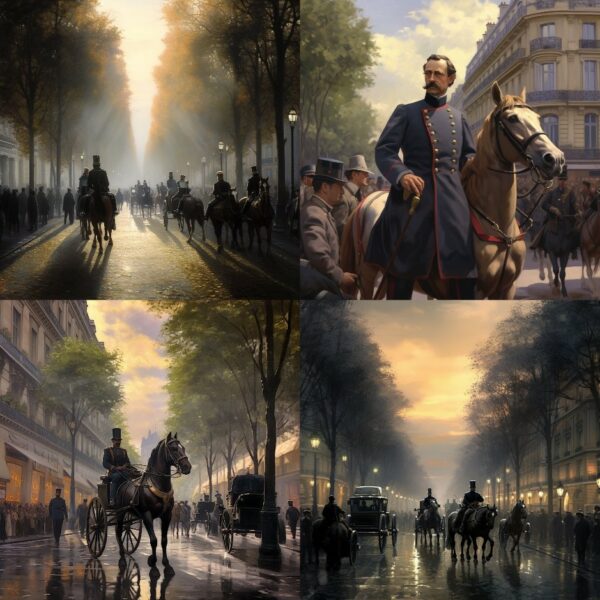

Pour rire, nous avons tenté quelques combos de personnages illustres afin de voir quels résultats pourraient émerger. Après avoir tenté un premier combo où nous cherchions à réunir le général de Gaulle, Pierre Brossolette et Jean Moulin sur les Champs Elysées, nous avons fini par abandonner, l’IA pédalant trop. Nous nous sommes limités à de Gaulle et voici quelques résultats :

Pour la blague et poussée par quelques esprits malfaisants fans d’Iron Sky nous avons tenté Hitler … Je vous laisse juger du résultat et du réalisme obtenus :

Après avoir exclu le T Rex, je retente l’expérience avec cette fois la volonté d’obtenir une création incluant Hitler, discutant avec Staline et Churchill … au bout 12 propositions j’ai commencé à obtenir une image ressemblant en partie à une situation connue mais extrêmement limitée. On peut s’en réjouir, l’IA ne dépasse pas encore Photoshop et ne permet pas tous les délires visuels !

Puis, dans une seconde expérience, j’ai voulu réunir Napoléon 1er et Napoléon III sur la même image … L’échec a été total ! Impossible de réunir sur une même création l’oncle et le neveu ou du moins, en moins de 10 générations tentées.

Par contre, sur des personnalités récentes, nous n’avons pas été déçus, même à partir de simples mots-clés : ici Donald Trump in jogging suit et voici l’une des quatre propositions qui a émergé, très réaliste en dépit d’un pied droit problématique :

Il y a peu, une improbable série réalisée via Midjourney a été remarquée, on y voyait le Roi Charles III se déhanchant dans un improbable costume criard dans un contexte de fête du samedi soir sans Travolta. En réalité, demander une création impliquant le prince Charles en train de danser dans une tenue excentrique n’a pas été si compliqué que cela (à un tout petit détail prêt : je voulais qu’il danse avec Jennifer Lopez …). Le même exercice a été réalisé avec la Reine Elizabeth II pour laquelle j’avais simplement demandé une robe couleur arc-en-ciel en hommage à sa garde-robe colorée. Le premier résultat obtenu est le bon, il est bluffant à un détail prêt : l’IA a oublié la tiare de la Reine (et son sac à main) :

Comment expliquer ce décalage entre des personnalités historiques, pourtant connues et reconnues par le grand public et très présentes sur Internet, mais que l’IA ne semble pas connaitre ? Il faut revenir à son fonctionnement qui puise ses ressources dans une partie seulement des possibilités offertes par le net : Pinterest, les sites d’informations et les sites marchands d’images en général. Plus la personnalité est récente et couverte médiatiquement (ce qui est le cas de la Royal Family), plus le réalisme et la perfection seront au rendez-vous dans la réalisation finale car le stock de photos dans lequel l’IA ira puiser est large et la personnalité omniprésente. Un article excellent publié sur le site Waxi.org fait d’ailleurs un point sur la manière dont les plateformes générant des images via l’IA fonctionne.

Enfin l’IA reste pénétrée par certains biais. Ainsi, si l’on souhaite créer une amazone, ce sera immanquablement la version de Wonder Woman interprétée par Gal Gadot qui servira de base à la réalisation finale, exit Linda Carter et les autres représentations. De manière générale l’IA est excellente pour tenter des personnages de jeux vidéo ou de fantasy, dans ce domaine la créativité semble sans limite et le professeur engagé dans un atelier jeux vidéo peut trouver avec ses élèves un support très utile à la création d’autant que sur ce thème, les images générées sont très propres et ne proposent que peu de déchets en comparaison des autres thématiques.

(je tiens à préciser qu’ici j’avais demandé une Catwoman en pensant à Michelle Pfeiffer, mais nous nous retrouvons avec la jumelle de Batman !)

Quant aux représentations ethniques, l’IA ne connait pas certaines différences notamment entre Asiatiques. Ici sur cet exemple, j’ai cherché à composer une femme samouraï, cette dernière restant un aspect encore trop peu connu de l’histoire féodale du Japon mais bien réelle comme l’atteste l’existence de Tomoe Gozo par exemple. Dans le résultat obtenu, on devine aisément que l’IA s’est servie d’images issues de films d’action chinois et non japonais, les premiers étant beaucoup plus nombreux et variés que les seconds. Au passage l’IA a oublié le temple grec que j’avais demandé en arrière-plan mais passons… Vous noterez également que notre guerrière est atteinte, comme beaucoup, de polydactylie !

De là, nous avons également testé la question des stéréotypes générés par l’IA avec, non pas une demande concernant d’éventuels modèles féminins (cela aurait été trop facile) mais masculins à partir des mots-clés suivants : dictator, eating, near a window. Les quatre premiers résultats montrent que pour l’IA un dictateur est forcément … un militaire médaillé souvent atteint d’embonpoint !

Un peu de censure malgré tout

Puis nous est venue l’idée de comparer les possibilités des autres plateformes concurrentes de Midjourney. Nous avons essayé Dall-E. Très vite nous avons été bloqués, un filtre empêchant la génération d’images basées sur une personnalité publique, ce qui n’a pas été le cas avec Midjourney qui, sans aucun problème nous a généré le Donald Trump recherché (qui, dans tous les cas, n’égale jamais l’original). La censure reste à débattre. Mais Midjourney connaît également certaines limites assez inattendues. Pour un ami qui m’en avait formulé la demande, j’avais tenté un combo incluant une figure incontournable de la culture manga : Sailor Moon. Là où le combo « Sailor Moon as a japanese pin up girl » a parfaitement fonctionné, par contre celui incluant Quentin Tarantino ou Kill Bill a été purement refusé d’entrée « Sailor Moon as a japanese warrior Quentin Tarantino » a été automatiquement rejeté avec une mention incluant que ma demande violait les standards de Midjourney !

La limite est compréhensible. Très vite, de fausses photos d’actualité réalisées avec Midjourney ont été diffusées sur Internet. Elles mettent en scène des personnalités dans des situations douteuses par des sites peu scrupuleux et elles ont été prises pour argent comptant par un public (déjà) crédule. L’IA tout comme le cinéma, la photographie et Photoshop, est détournée de ses usages (ré)créatifs à des fins politiques douteuses. Si le schéma n’est pas neuf, pourtant il demeure dangereux par sa viralité et le manque de recul d’un certain public qui ne prend pas et qui ne veut pas prendre le temps de réfléchir à ce qu’il voit.

Midjourney : quelle utilité en Histoire et en Géographie ?

En histoire, affirmons-le d’entrée, rien ne peut remplacer le document iconographique correspondant au contexte étudié. Cela ne sert à rien de générer des images de de Gaulle sur les Champs Elysées alors qu’elles existent déjà et en prime c’est contestable et totalement condamnable d’utiliser une image fictive autrement qu’à des fins illustratives.

En géographie, nous avons également testé l’intérêt et nous avons envisagé un exercice concernant l’aménagement du territoire mais là aussi, le résultat ne fut pas complètement à la hauteur des espérances. L’IA reste limitée car certaines demandes n’ont pas été prises en compte. Ici nous avons tenté deux exercices :

- Le premier basé, sur une demande de Déborah Caquet, Présidente des Clionautes, sur les mots clés incluant : une ville dense durable (Sustainable European city centre at the bottom of the valley with river, natural light). Le résultat fut le suivant :

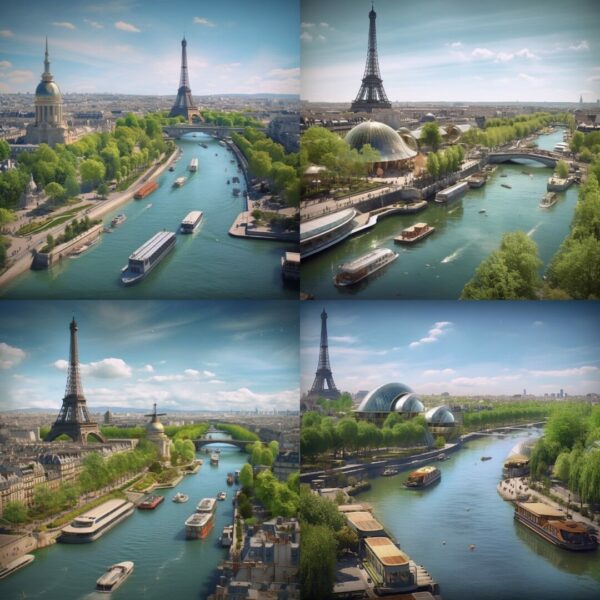

- Le second sur l’aménagement de Paris en y intégrant la dimension écologique. Afin de bien marquer l’espace parisien, une photo de référence a été téléchargée, en l’occurrence celle-ci depuis le site Worldatlas.com :

Voici le résultat :

Sans l’image de référence voici les premières propositions générées ; les suivantes montraient une Tour Eiffel souvent déplacée à des endroits improbables :

Les résultats restent intéressants et peuvent être soumis à une lecture critique de l’image mais peuvent-elles servir dans le cadre d’une évaluation ? Je pose ici l’idée qu’une image générée par les élèves n’est pas notable en soi, car pour les même mots-clés les élèves aboutiront tous à des résultats différents (4 milliards de possibilités) le résultat serait trop aléatoire et il paraît impossible de vouloir prétendre noter un exercice réalisé par IA il me semble ; comment imputer une erreur à l’élève qui n’a pas la maîtrise de la production finale ? À l’inverse, l’étude critique d’une image produite par les élèves peut s’avérer intéressante et pourrait être parfaitement notée dans le cadre de l’enseignement de la géographie. Travailler avec ce type de plateforme (le jour où les tarifs seront acceptables pour les enseignants) est envisageable en collaboration avec le professeur d’arts plastiques ou avec le collègue qui enseigne la spécialité NSI. Les professeurs peuvent par exemple envisager de travailler avec les élèves les influences artistiques et les stéréotypes qui président aux choix effectués par l’IA. Cela peut s’avérer un exercice intéressant mais à condition d’avoir solidement préparé et d’avoir des connaissances en amont afin de repérer assez vite les références artistiques.

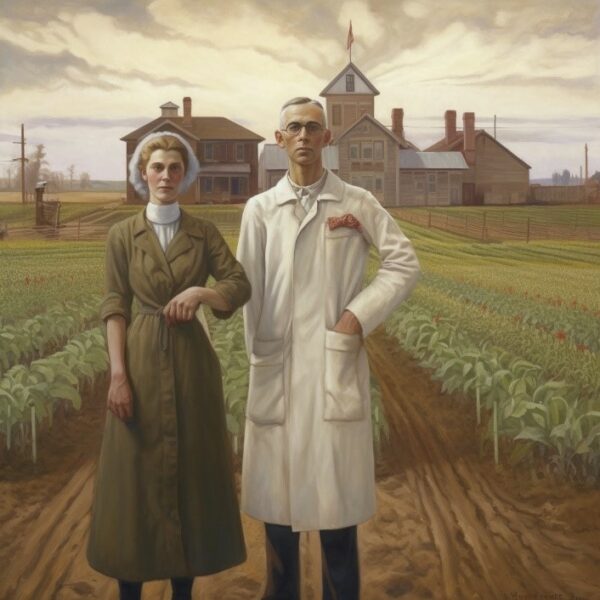

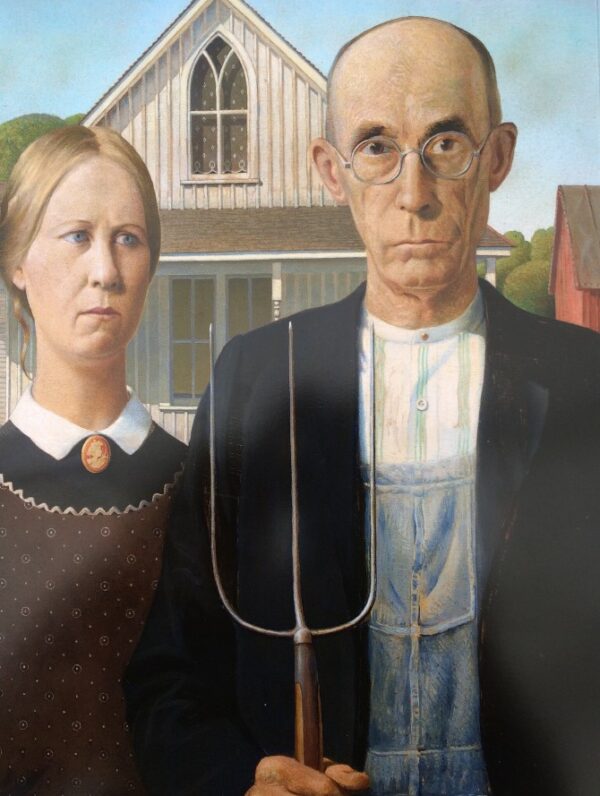

Ainsi sur cette proposition, j’avais demandé en mots-clés : « World War I soldier with a nurse in front of a farm ». Voici deux des quatre résultats obtenus :

La première influence qu’un professeur se doit de reconnaître est celle d’Edgar Hooper dont l’intelligence artificielle s’est indéniablement inspirée. Pour le reste, je vous laisse trouver ce qui a pu guider l’IA sur le style et les autres ressources disponibles sur Internet 😊

Enfin, l’EMC et l’option DGEMC peuvent être aussi l’occasion de les initier au droit à l’image et à la caricature et à la législation qui va avec. Les images générées par les élèves seraient proposées ensuite à la réflexion commune.

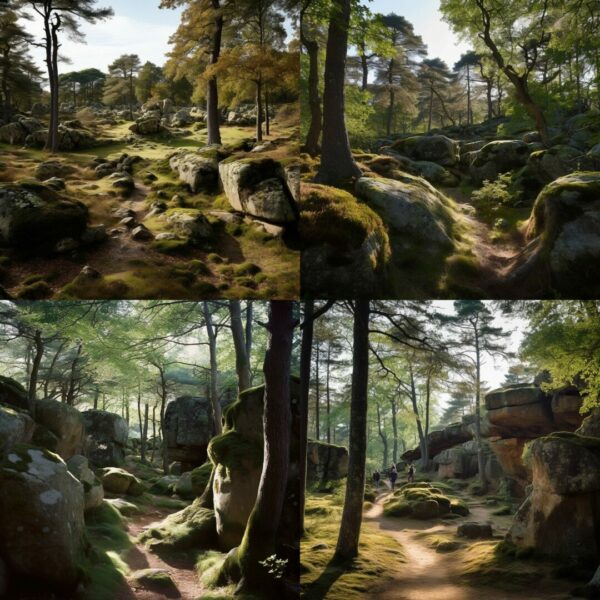

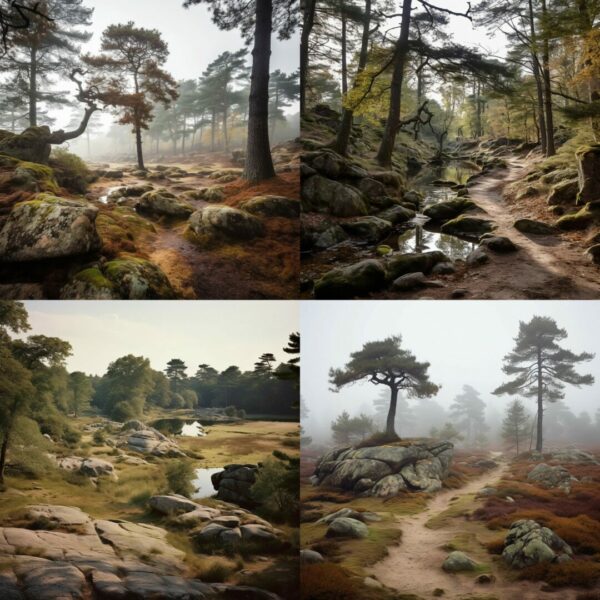

Enfin, j’ai également tenté une dernière expérience : rentrer un texte afin de voir l’image produite par l’IA. Pour cela, j’ai choisi l’extrait d’un texte de George Sand publié récemment sur Cliotexte, et en premier en version française :

« La forêt de Fontainebleau n’est pas seulement belle par sa végétation ; le terrain y a des mouvements d’une grâce ou d’une élégance extrême. Ses entassements de roches offrent à chaque pas un décor magnifique, austère ou délicieux. Mais ces ravissantes clairières, ces chaos surprenants, ces sables mélancoliques deviendraient navrants, peut-être vulgaires s’ils étaient dénudés ».

Puis, me rappelant que l’IA préfère l’anglais, j’ai rentré le même texte traduit cette fois et voici le résultat :

Déçue …. Mais on s’amuse bien !

J’avoue avoir été déçue au départ par l’IA sur le plan pictural. Pourquoi ? Lorsque je me suis lancée, j’avais en tête une première idée du résultat que je souhaitais obtenir. Immanquablement j’ai donc été déçue par la proposition de l’IA. Par conséquent, il faut savoir se déconnecter d’une quelconque attente. Par conséquent, il paraît difficile de l’utiliser dans un cadre contraint avec des normes et des attentes plus ou moins précises, car nous trouverons toujours à pinailler. Malgré tout, si nous savons nous servir de Photoshop il peut constituer un superbe brouillon de base à retravailler pour obtenir un résultat personnalisé satisfaisant. Si nous restons honnêtes avec nous-même, on en ressort avec le sentiment d’être à moitié l’auteur car ce n’est pas notre trait, ce ne sont pas nos choix de disposition ni de coloration, ce n’est pas notre sensibilité. Pour autant il demeure cette petite satisfaction d’avoir cherché et cliqué au bon moment pour produire une image qui va contenter nos sens.

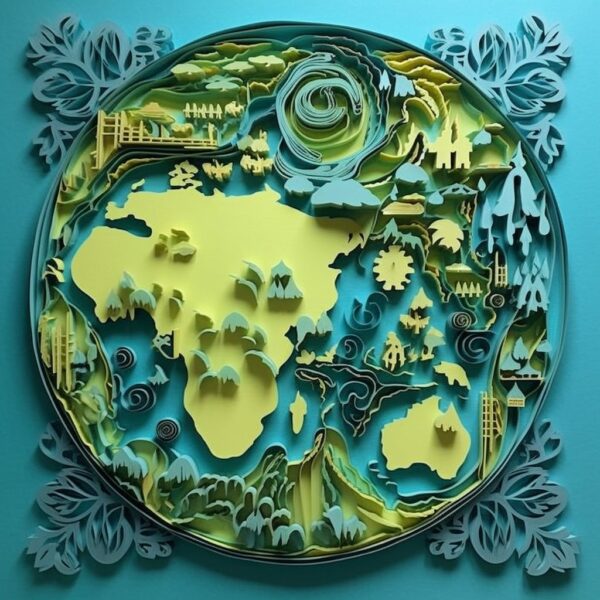

En dehors de ces réserves et observations diverses, Midjourney permet de réaliser parfois de belles images à but illustratif. C’est pourquoi, en guise de conclusion, pour le plaisir des yeux, je vous propose quelques-unes des images que j’ai générées avec les termes-clés utilisés :

map of the world colorfull green blue, kirigami –seed 555

port of an ecological Chinese city with traditional boats with red sails, neon lights on buildings, night light, moon, very realistic

French Pin Up Second World War French Cancan

Metropolis, with towers, ecologic towers, flying cars, neons –seed 500

Marilyn Monroe as Cleopatra film

Logo save water

Les autres articles du dossier :

Merci beaucoup Madame.

Magnifique.

J’ai kiffer Trump en Orange rires . . .